Dieser Samstag war sehr aufregend für uns. Es war der Tag an dem die Brazil Open geendet ist und an dem die Ergebnisse offiziell verkündet wurden.

Wir haben uns online getroffen um die Preisverleihung gemeinsam zu erleben und die Tabelle mit den Ergebnissen wurde langsam gefüllt. Da die Ergebnisse vom letzten zum Ersten Platz verkündet wurden, wurde es immer aufregender je mehr Plätze in der Tabelle gefüllt wurden, die nicht unseren Namen beinhalteten.

Bevor wir aber über die Ergebnisse mit mehr Details reden, lasst mich euch kurz erzählen worum es in der Brazil Open ging. Durch COVID-19 konnten wir leider nicht an einem regulären Turnier teilnehmen bei dem unsere Roboter miteinander Fußball spielen dürfen. Deshalb mussten die Organisatoren der Brazil Open kreativ werden und sich eine Möglichkeit ausdenken wie die Teams trotzdem gegeneinander antreten konnten.

Der Wettkampf bestand deshalb aus zwei Teilen.

Der eine Teil war, dass wir ein 10 Minuten Video erstellen sollten in dem wir uns selber, unsere Roboter und unsere Forschung präsentieren. Ihr könnt euch dieses Video hier ansehen:

Der andere Teil des Wettkampfes bestand daraus, dass wir Roboter in Bildern erkennen mussten. Es gab Punkte dafür, wie viele Roboter richtig erkannt wurden und wie schnell wir in der Lage waren die Bilder zu verarbeiten.

Die Organisatoren haben uns eine Liste von Bildern bereit gestellt die wir benutzen konnten um unser System zu trainieren. Die Bilder stammen dabei aus dem ImageTagger, den wir entwickelt haben.

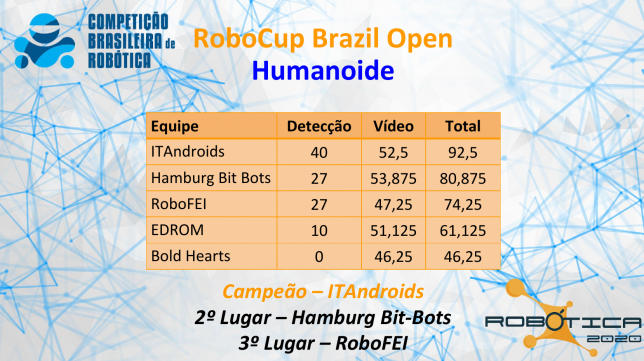

Jetzt wo ihr ein wenig mehr über den Wettkampf Bescheid wisst, können wir uns jetzt die Ergebnisse anschauen.

Die erste Spalte sind die Team Namen, gefolgt von den Punkten für die Roboter Erkennung und den Punkten für die Videos.

Wie ihr sehen könnt, haben wir einen gemeinsamen zweiten Platz, mit dem Team RoboFEI, in der Roboter erkennen Herausforderung erzielt. Wir haben dafür ein neuronales Netzwerk namens YOLOv4-tiny verwendet und konnten damit 94% der Roboter richtig erkennen. Wir konnten dabei 35 Bilder in der Sekunde verarbeiten. Team RoboFEI hat etwas weniger Roboter erkannt, war dafür aber schneller in der Verarbeitung der Bilder.

Unser Video hat die höchste Punktzahl in der RoboCup Brazil Open für Humanoid Robots Liga erzielt. Damit kamen wir auf insgesamt 80.875 Punkte.

Wir sind sehr glücklich mit den Ergebnissen und hatten eine Menge Spaß bei diesem Wettbewerb. Wir wollen uns hiermit bei den Organisatoren für das Veranstalten dieses Wettbewerbs bedanken und gratulieren den ITAndroids zum Sieg!